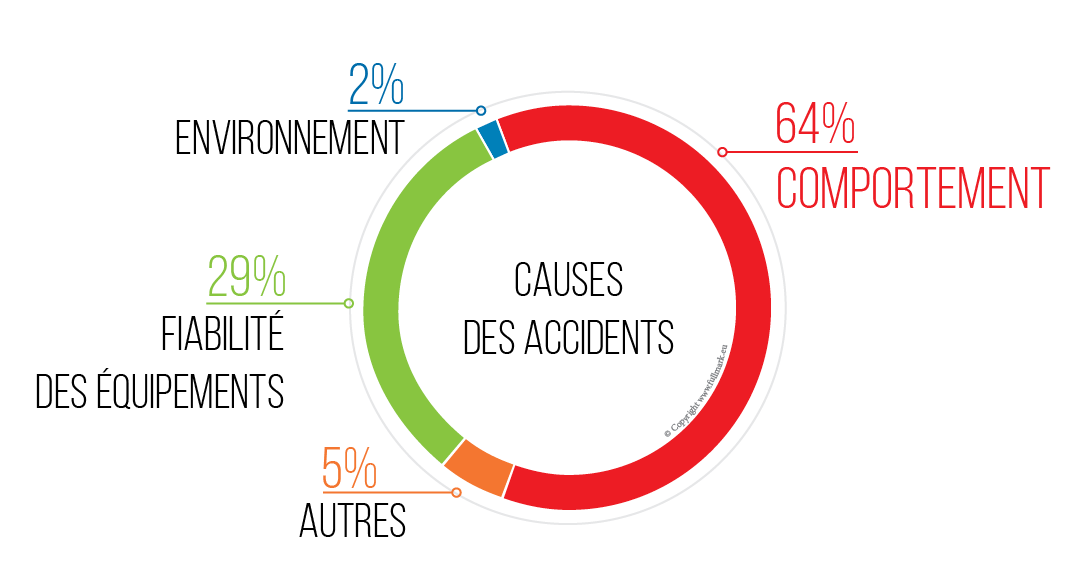

Comportements : décryptage des véritables causes d’accidents

Quand j’entends « C’est à cause des comportements » pour expliquer un accident du travail — « ils ne respectent pas les règles », « c’est du facteur humain » — je trouve qu’on rate l’essentiel. Cette vision est pratique : elle désigne un responsable facile, mais elle cache souvent la réalité profonde.

1. Ce n’est pas simplement un problème individuel

Prenons un exemple : un opérateur contourne une procédure de sécurité. Sur le papier, cela paraît être une défaillance personnelle. Mais l’enquête révèle que :

la machine est en panne depuis trois semaines,

l’équipe de maintenance est sous-dimensionnée,

les délais d’intervention sont très longs,

la pression sur la production est très élevée.

Autrement dit, l’opérateur ne « triche » pas par malveillance, mais parce que le système dans lequel il évolue ne lui laisse pas d’autre choix réaliste. Les comportements « à risque » sont rarement des écarts isolés : ils naissent d’un contexte — d’une culture, d’une organisation, d’arbitrages entre production et sécurité.

🛠️ Au lieu de corriger les individus, ne serait-il pas plus efficace de corriger les conditions ?

2. Chercher les causes racines, pas juste le coupable

Une véritable enquête d’accident ne s’arrête pas après avoir identifié le geste. Elle pose des questions comme :

Pourquoi la machine est-elle restée irréparable si longtemps ?

Pourquoi les procédures sont perçues comme trop lourdes ou peu claires ?

Pourquoi les équipes ne sont-elles pas formées pour anticiper ces situations ?

Comment rééquilibrer la pression entre les objectifs de production et ceux de sécurité ?

Corriger ces leviers demande du temps, de l’humilité, et surtout une volonté réelle de transformer l’organisation, pas seulement de punir les individus.

3. Notre cerveau est loin d’être un observateur objectif

Même dans une organisation très bien pensée, il y a un acteur que l’on oublie trop souvent : notre cerveau.

Notre perception du réel est biaisée :

on filtre, simplifie, interprète les situations,

on utilise des raccourcis mentaux (heuristiques),

et on est soumis à des biais cognitifs comme l’excès de confiance, le biais de normalité ou encore l’illusion d’optimisme.

Ces biais influencent profondément la manière dont les risques sont perçus et les décisions sont prises.

Par exemple :

Le biais de normalité (ou normalcy bias) conduit à sous-estimer la gravité d’un danger parce que « tout va bien » jusqu’à présent. Wikipédia+2The Behavioral Scientist+2

Le planning fallacy est notre tendance à sous-estimer le temps ou les ressources nécessaires à une tâche, même quand on a déjà vécu des retards similaires. Wikipédia

L’excès de confiance (ou overconfidence bias) amène à surestimer nos compétences ou notre capacité à gérer un risque. Wikipédia

Sur le plan de la sécurité au travail, des études montrent que ces biais peuvent mener à des comportements dangereux. healthandsafetyinternational.com+1

Plus encore, des chercheurs comme Teemu Reiman et Carl Rollenhagen (VTT) ont mis en lumière des biais organisationnels : certaines approches de la sécurité traitent les travailleurs comme des acteurs isolés, sans tenir compte de leur contexte social et cognitif. IDEAS/RePEc+1

4. Agir : allier formation cognitive et ajustement du système

Pour piloter une vraie culture sécurité, il faut deux leviers complémentaires :

Former aux biais cognitifs

Expliquer à chacun les biais (excès de confiance, normalité, ancrage, etc.) pour qu’ils les repèrent en situation.

Ce n’est pas un exercice de culpabilisation, mais un outil d’empowerment : donner aux collaborateurs une meilleure compréhension de leur propre prise de décision.

Dans des secteurs comme l’aviation ou l’industrie à haut risque, cette formation est déjà largement utilisée.

Mettre en place des stratégies d’aide à la décision

Utiliser des pré-mortems : imaginer à l’avance ce qui pourrait mal tourner.

Organiser des pauses réflexives ou des check-lists prenant en compte les biais cognitifs.

Encourager une culture où les collaborateurs peuvent questionner, proposer, remonter des signaux faibles.

Repenser l’organisation

Réduire la pression sur la production quand elle entre en conflit avec la sécurité.

Assurer une maintenance fiable, des ressources suffisant.

Rendre les procédures réellement utilisables sur le terrain — pas seulement sur le papier.

Intégrer les retours d’expérience des opérateurs : ce sont eux qui vivent le terrain, et leurs observations sont précieuses.

5. Ce n’est pas une déresponsabilisation

Je sais ce que certains pourraient dire : « Oui, mais si on dit que tout vient de l’organisation, on retire la responsabilité des individus ». Je comprends cette inquiétude, mais je ne suis pas d’accord :

L’opérateur reste un acteur clé. Il peut alerter, proposer des améliorations, être acteur de sa sécurité.

Mais sans moyens (temps, formation, matériel), sa marge de manœuvre est limitée.

Et surtout, changer seulement les comportements sans agir sur le système, c’est risquer de revenir sans cesse sur les mêmes accidents — sans jamais résoudre les causes profondes.

Ressources utiles pour aller plus loin

Human and Organizational Biases Affecting the Management of Safety — Teemu Reiman & Carl Rollenhagen (journal Reliability Engineering & System Safety) : une analyse académique des biais structurels en management de la sécurité. Cris+1

Officiel Prévention — Identifier les biais cognitifs en sécurité au travail : liste des biais courants et impact. Officiel Prévention

Health & Safety International — « 7 cognitive biases that lead to unsafe work » : un bon point de départ pour comprendre comment les biais se manifestent. healthandsafetyinternational.com

NATO / JWC — « The Case for Humility in Planning and Decision-Making » : un guide pratique sur la prise de décision et les biais. jwc.nato.int

En résumé

Blâmer les comportements, c’est facile — mais souvent inefficace.

Il faut creuser les conditions organisationnelles : maintenance, ressources, formation, culture.

Le facteur humain, avec ses biais cognitifs, joue un rôle clé dans les prises de risque.

La prévention doit combiner :

formation aux biais,

stratégies d’aide à la décision,

ajustement du système de travail.

Changer ces trois dimensions, c’est bâtir une culture sécurité durable, pas un pansement sur les symptômes.

Pour approfondir sur les biais cognitifs : https://guidehse.fr/biais-cognitifs-hse/

Pour lire mes autres articles : https://alsacehseconseil.fr/blog/